下面给出常见的表情绑定技术及其区别,帮助你快速了解各自的适用场景与优劣势。

1. 基于骨骼的表情绑定(Rigging with Bones)

原理:通过骨骼系统驱动网格顶点,表情由面部骨架的旋转/平移实现。

优点:

- 结构清晰,便于复用和动画人员操作。

- 可以实现较大范围的面部变形,稳定性好。

缺点:

- 细腻的表情细节受限,需大量权重绘制和次级变形。

- 绑定过程较繁琐,人工工作量大。

适用场景:传统3D动画、游戏角色、需要可控骨骼层级的表情。

2. 混合体积/形态融合表情绑定(Blendshape / Morph Target)

原理:通过一组目标形状(形态目标)来改变网格外观,表情由权重混合得到。

优点:

- 能捕捉细腻的表情变化(如眼角、嘴角的微妙变化)。

- 实时性能较好,易于艺术家直接控制。

缺点:

- 需要大量的形态目标,存储和创建成本高。

- 不易自动化,复杂表情组合可能需要大量目标。

适用场景:影视级角色、虚拟偶像、需要高保真表情的场景。

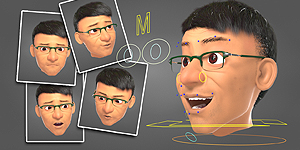

3. 绑定到面部追踪/表情捕捉数据(Facial Capture / Facial Tracking)

原理:使用传感器或相机获取的面部关键点、网格变形或权重,驱动绑定系统实现表情。

优点:

- 能实现真实的面部表情动态,快速从真人数据迁移。

- 与现实表情高度契合,适合个性化表达。

缺点:

- 受设备和捕捉质量影响较大,需后期清理和校正。

- 数据清洗与映射(retargeting)较复杂。

适用场景:视频游戏、虚拟主播、影视特效中的实时/离线表情驱动。

4. 基于实时动画驱动的隐式/基于神经网络的表情绑定(Neural / Avatar Mapping)

原理:利用神经网络将输入(如语音、表情视频、控制信号)映射到目标角色的表情驱动参数。

优点:

- 能实现高度自然、连续平滑的表情过渡。

- 可处理跨人物、跨风格的绑定问题(风格迁移)。

缺点:

- 需要大量训练数据和较高的计算资源。

- 模型可解释性和可控性可能较差,调参复杂。

适用场景:虚拟偶像、实时vr/ar应用、需要自然表情的交互式系统。

5. 皮肤权重驱动的细粒度变形(Skinning with Corrective Shapes)

原理:在骨骼或驱动的基础上,添加纠正形状(Correctives)来修正特定表情区域的变形。

优点:

- 提升面部在极端表情下的自然度,减少伪影。

缺点:

- 需要额外的目标形状和权重管理,工作量增加。

适用场景:需要高质量细节的角色绑定,尤其在眨眼、笑纹等处。

6. 多通道驱动(Multi-Channel Facial Rig)

原理:将不同的驱动通道(如眼睛、嘴、眉毛)分开绑定,再在一个统一的控制系统中整合。

优点:

- 灵活性高,团队协作友好,易于分工。

- 可以独立调优各个区域的表情效果。

缺点:

- 绑定和保持一致性需要额外的工作量和测试。

适用场景:复杂角色、需要模块化控制的项目。

7. 基于网格权重的模板驱动(Pose-Driven / Bone-Influence Mappings)

原理:利用网格顶点的权重映射到预设的表情模板或姿态模板进行驱动。

优点:

- 实现简单,便于快速原型化。

缺点:

- 自然度和细节受限,难以实现高保真。

适用场景:早期原型、教育演示、低多边形角色。

如何在项目中选择合适的表情绑定技术?

可以从以下几个维度去考虑:- 目标质量:需要高保真(如影视特效)还是实时性更重要(如游戏、直播)?

- 工作量与成本:是否有充足的艺术家资源来创建大量形态目标或纠正形状?

- 后期维护:是否需要方便迭代、跨团队协作、版本控制?

- 数据来源:是否有面部捕捉数据、是否需要跨平台迁移/多角色适配?

- 硬件与性能约束:目标平台的CPU/GPU能力、内存和网络带宽。